强化学习数学原理 - 必备数学基础 (Mathematical Preliminaries)

1. 为什么 RL 的数学门槛高? 强化学习被公认为 AI 领域最难学的分支之一,原因在于它融合了: 概率论(状态随机性)。 优化论(梯度下降)。 随机过程(轨迹演化)。 泛函分析(算子与不动点)。 为了让你在后续章节不被公式劝退,本篇博文基于教材附录,总结了最核心的数学工具。 2. 概率论:不只是扔骰子 2.1 全期望公式 (Law of Total Expectation) - 必考点 在推导贝尔曼方程时,你会反复看到这个技巧: \mathbb{E}[X] = \mathbb{E} [ \mathbb{E}[X | Y] ] 在 RL 中,它表现为:当前状态的价值 = 下一个可能状态价值的加权平均。 2.2 状态分布 (Stationary Distribution) 当 Agent 在环境中跑了很久以后,它处于各个格子的概率会稳定下来。 数学本质:转移矩阵 P_\pi 的左特征向量。 意义:这决定了我们在优化目标函数时,应该给哪些格子更大的权重。 3. 随机过程:关于“收敛”的艺术 3.1 鞅...

强化学习数学原理 - 序章:一张图看懂强化学习 (Course Introduction)

1. 欢迎来到强化学习的数学世界 强化学习(Reinforcement Learning, RL)近年来在围棋(AlphaGo)、游戏(Dota 2, StarCraft II)以及大模型训练(RLHF)中取得了举世瞩目的成就。然而,很多初学者往往陷入“会调包,不懂原理”的困境。 本系列笔记基于 西湖大学赵世钰老师 的经典教材《Mathematical Foundations of Reinforcement Learning》及其 B 站配套课程整理而成。我们的目标是:不仅知道 RL 怎么用,更要从数学底层看透它为什么能跑通。 2. 一张图讲完强化学习原理 在课程的开头,赵老师用一张极其经典的图概括了 RL 的全貌。理解了这张图,你就理解了 RL 的核心动力学。 核心循环 (The Loop) Agent (智能体):决策的主体(比如机器人、AI 程序)。 Environment (环境):Agent 交互的对象(比如物理世界、棋盘)。 State (S_t):环境给 Agent 的反馈信息(你在哪?情况如何?)。 Action (A_t):Agent 根据 S_t...

扩散模型

扩散模型是一种特殊的VAE,其灵感来自于热力学:一个分布可以通过不断地添加噪声变成另一个分布。放到图像生成任务里,就是来自训练集的图像可以通过不断添加噪声变成符合标准正态分布的图像。 图像生成网络会学习如何把一个向量映射成一幅图像。设计网络架构时,最重要的是设计学习目标,让网络生成的图像和给定数据集里的图像相似。VAE的做法是使用两个网络,一个学习把图像编码成向量,另一个学习把向量解码回图像,它们的目标是让复原图像和原图像尽可能相似。学习完毕后,解码器就是图像生成网络。扩散模型是一种更具体的VAE。它把编码过程固定为加噪声,并让解码器学习怎么样消除之前添加的每一步噪声。

无标题

原型=动态演化的语义锚点 原型的关键作用 1. 类级表示 经过层级学习、去噪后的特征,更纯净、更有代表性 2. 对比学习的监督信号 不只是"拉近同类",而是"拉向类中心" 语义信息: 原型包含了这个类的核心特征 例如:猫原型 = “有毛” + “四条腿” + “小体型” 辅助分类: 新样本可以和各类原型对比 与哪个原型最接近,就属于哪一类 知识迁移: 原型可以在不同任务间共享

开学三个月小记

...

深度学习优化器全家桶:从 SGD 到 AdamW 及未来

在深度学习的训练过程中,优化器 (Optimizer) 扮演着至关重要的角色。它决定了网络参数更新的方式,直接影响模型的收敛速度和最终性能。本文将深入剖析深度学习中常见的优化器,从最基础的 SGD 到目前最流行的 AdamW,以及一些前沿的变体。 1. 梯度下降家族 (Gradient Descent Variants) 1.1 BGD, SGD 与 Mini-batch SGD BGD (Batch Gradient Descent):每次迭代使用全部样本计算梯度。 优点:梯度准确,收敛稳定。 缺点:计算量大,内存无法承受,无法在线更新。 SGD (Stochastic Gradient Descent):每次迭代使用一个样本。 优点:计算快,引入噪声有助于跳出局部最优。 缺点:震荡剧烈,收敛慢,无法利用向量化加速。 Mini-batch SGD:折中方案,每次使用一批样本(如 32, 64)。这是实际中最常用的形式。 $$ w_{t+1} = w_t - \eta \cdot \nabla L(w_t) $$ 1.2 Momentum (动量法) 为了抑制...

深度学习损失函数:从 MSE 到 Focal Loss

在深度学习中,损失函数 (Loss Function) 是连接模型预测与真实标签的桥梁,它定义了模型的优化目标。选择合适的损失函数往往能起到事半功倍的效果。本文将对深度学习中常见的损失函数进行梳理,从基础的回归/分类到进阶的难例挖掘和度量学习。 1. 回归任务 (Regression) 回归任务的目标是预测连续值。 1.1 MSE (L2 Loss) 均方误差 (Mean Squared Error): $$ L = (y - \hat{y})^2 $$ 特点:收敛快,但对异常值 (Outliers) 非常敏感(因为误差被平方放大了)。 1.2 MAE (L1 Loss) 平均绝对误差 (Mean Absolute Error): $$ L = |y - \hat{y}| $$ 特点:对异常值鲁棒,但在 0 点处不可导,梯度恒定可能导致收敛困难。 1.3 Smooth L1 Loss 结合了 L1 和 L2 的优点: 在误差较小时($|x| < 1$)使用 L2(平滑,可导)。 在误差较大时($|x| \ge 1$)使用...

深度学习杂谈:残差、MAE与特征维度的本质思考

最近有一些问题,正好记录下来了一些,用AI探讨了一下这些问题。 1. 残差 (Residual) 的本质:仅仅是保留原始信息吗? 问题: 残差的本质是什么?为什么有用?是因为保留了之前的原始信息的特征吗?那么添加动量 (Momentum) 也是保留之前的原始信息,和残差的本质有什么区别吗? 残差连接 (Skip Connection) 残差网络 (ResNet) 的核心公式是 $y = F(x) + x$。 确实,从直观上看,$+x$ 这一项直接将上一层的原始信息“保留”并传递到了下一层。这使得网络在初始化阶段即使 $F(x)$ 接近于 0,整个网络也近似于一个恒等映射 (Identity Mapping),梯度可以无损地反向传播。 本质区别: 残差 (ResNet) 解决的是 模型结构 (Model Architecture) 和 梯度流 (Gradient Flow) 的问题。它是在空间/层级维度上,让深层网络更容易训练,避免梯度消失。它让网络“有机会”去学习恒等映射,如果某一层是多余的,网络可以将 $F(x)$ 权重置为 0,自动“跳过”这一层。 动量...

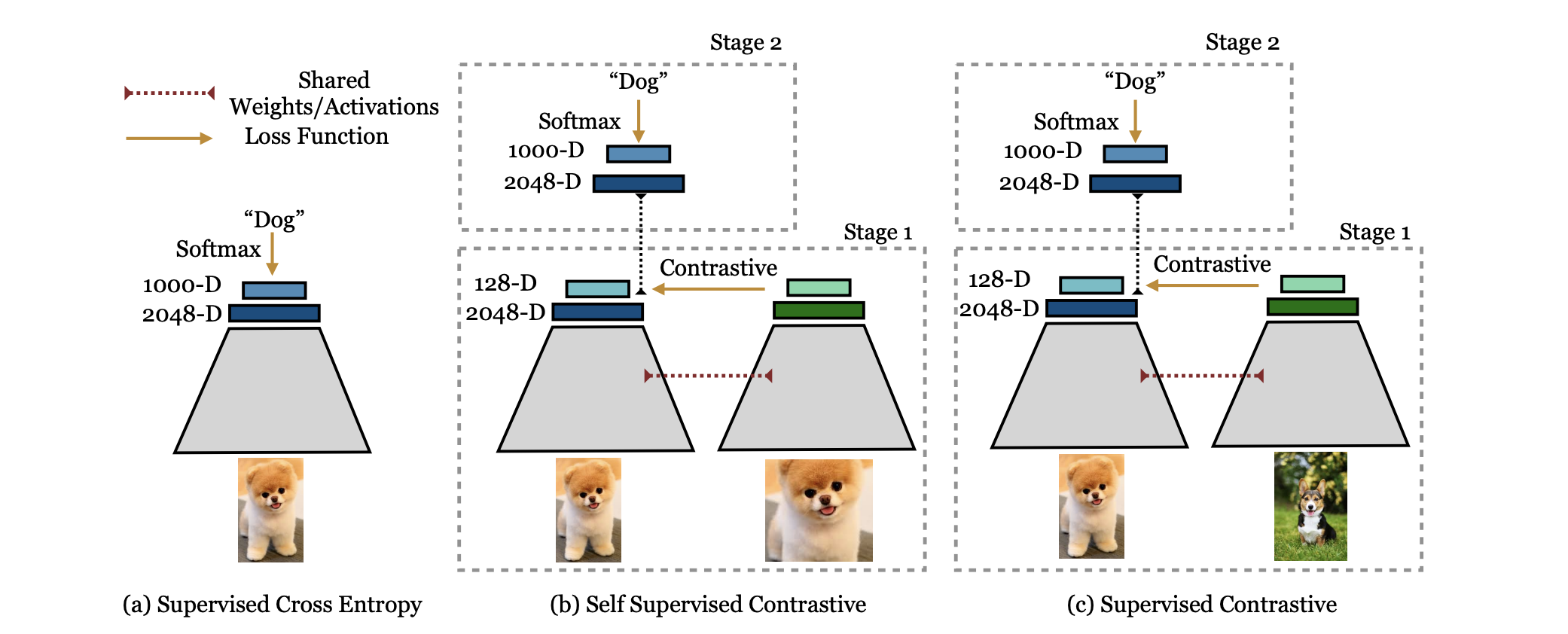

监督对比学习

Supervised Contrastive Learning 论文地址:https://arxiv.org/pdf/2004.11362 代码地址:https://github.com/HobbitLong/SupContrast 引言 监督对比学习(Supervised Contrastive Learning, SupCon)...